A Bayesian Nonparametric Approach to Image Super-resolution

arxivからの論文

http://arxiv.org/pdf/1209.5019.pdf

A Bayesian Nonparametric Approach to Image

Super-resolution

Gungor Polatkan, Mingyuan Zhou, Lawrence Carin, David Blei, and Ingrid

Daubechies

ノンパラメトリックベイズでは有名な Bleiのグループとの共同研究といった感じでしょうか?

超解像技術(super-resolution)は低解像度画像から高解像度画像を作る技術.

全画素の組み合わせに対して,実際に観測される組み合わせは非常にスパースであることから,

パッチを組み合わせることで,高解像度画像を低解像度画像から復元することができます.

そのためには,辞書(Dictionary)を持つ必要があるのですが,

それをどのように作るかが問題となります.

筆者らは過去に

NIPSで

Non-Parametric Bayesian Dictionary Learning for

Sparse Image Representations

http://books.nips.cc/papers/files/nips22/NIPS2009_0190.pdf

を発表しており,ノンパラメトリックベイズを用いて,Dictionary Learning にノンパラメトリックベイズを

応用するということをやっています.

それをsuper resolutionに応用するというのが主な筋立てです.

基本的にスパースな表現を得る場合には,L1ノルムを用いて刈り込む事が多くて,

超解像でもこれがよく用いられます.

Image Super-Resolution via Sparse Representation

Jianchao Yang et al.

などが良くリファレンスされるらしいです.

これに対して,ノンパラメトリックベイズ業界(?)ではスパースな表現にする,

つまり用いない次元を作るような場合には,ベータ・ベルヌーイ分布を導入し,スイッチを作るのが定石です.

例えば,

Sharing Features among Dynamical Systems

with Beta Processes

Emily B. Fox et al.

http://videolectures.net/nips09_fox_sfa/

では,HDP-HMM の各隠れ状態に対してストリーム毎にベータ・ベルヌーイのスイッチを設けて,使わない隠れ状態をオフにします.

ちなみに, @k_ishiguro さんの,

Subset Infinite Relational Models

Katsuhiko Ishiguro et al.

でも,ベータ・ベルヌーイのスイッチをつくって,汎用的な出力分布を用いる(IRMの外に吐き出してしまう)か,

通常のIRMの側に入れるかをえらぶようにしていたりします.

というわけで,

「L1刈り込みの代わりを,ノンパラベイズでやるなら,やっぱベータ・ベルヌーイっしょ!」

という,結構ストレートフォワードな適用があるわけです.

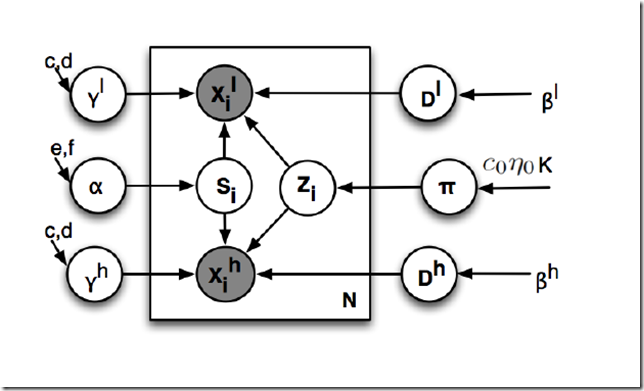

グラフィカルモデルはこんな感じ.

l と h はlow resolution と high resolutionを表している.

xl と xh が観測.

Di と Dh が辞書.

で si が係数なんですが,

zi がいわゆるベータ・ベルヌーイのスイッチで,0,1 をとる.

これによって,使う基底,使わない基底が,0,1でオン・オフされることで,

スパース表現を得るわけである.

なんとも,ストレートフォワードな論理である.

ちなみに,これだけでは綺麗にならないみたいで,最後に平滑化処理っぽいことをやる.

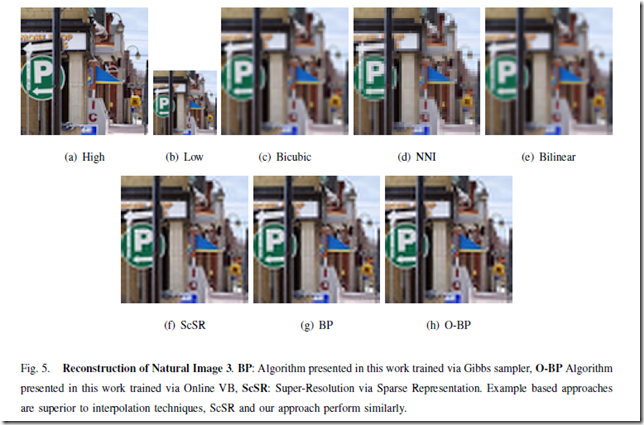

実験の結果は

こんなかんじなのだが,正直,よくわからない・・・.

どうも既存手法に勝てているか微妙なのだが,

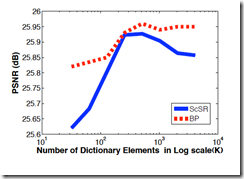

なるほどな,とおもったのは, Fig.8 で

こんな図がある.

これは,辞書の要素数(もとの次元数)を大きくしていった際,BPの場合は打ち切り最大数を大きくしていった時にどうなるか

を示しているのだと思うが,

その時に,ScSR(L1ノルムでのスパースコーディング)はピークを持ってしまう.

これに対しノンパラメトリックベイズのアプローチでは,十分な 要素数があれば,良い値を推定できるので,その良さが維持される.

これは,BPのアプローチがもともと無限の状態数を前提として組まれているのに対して,

L1の正則化項は 無次元量でもなく,要素数に影響を受けてしまうからだろう.

なるほどねー.

とは思うが,計算量とか考えても,実用的にはL1で行ったほうが,楽で実用的なのかなぁ,と思った次第でございます.

本内容は,

Xian-Hua Han (韓 先花) Ph.D にご紹介いただいて (Thank you very much

http://www.iipl.is.ritsumei.ac.jp/XHHan/index.html

それを,僕が勝手に理解したものを書いたものであり,

この記事の内容に誤りがあった場合は,僕を責めてくださいませ.

![ビブリオバトル[知的書評合戦]](img/bn_biblio.jpg)

Angelatepsy 2024-12-31 (tue)

Каждый врач клиники имеет глубокие знания в области фармакологии, психофармакологии и психотерапии. Они регулярно участвуют в профессиональных конференциях, семинарах и тренингах, чтобы быть в курсе последних достижений в лечении зависимостей. Такой подход позволяет нашим специалистам применять самые эффективные и современные методы терапии.

Узнать больше - наркологический центр в москве

sight care reviews 2025-01-01 (wed)

It’s impressive that you are getting ideas from this post as well as from our discussion made at this time.

my blog post - sight care reviews

Aishaget 2025-01-01 (wed)

Преимущества вызова нарколога на дом:

Получить больше информации - капельница от запоя вызов на дом воронеж

Yolandeomisa 2025-01-02 (thu)

Преимущества капельницы от запоя на дому очевидны:

Выяснить больше - капельница от запоя с выездом на дом иркутск

Claudialab 2025-01-05 (sun)

Наша основная цель — помочь пациентам восстановить как физическое, так и психоэмоциональное здоровье. Мы осознаем, что лечение алкоголизма — это многогранный процесс, включающий не только медикаментозную терапию, но и психотерапевтическую поддержку, а также программы социальной реабилитации. Индивидуальный подход к каждому пациенту — ключ к успешному выздоровлению и долгосрочной ремиссии.

Выяснить больше - капельница от запоя в стационаре

Aishaget 2025-01-05 (sun)

Важнейшую роль в процессе капельницы от запоя играет врач-нарколог. Он отвечает за разработку индивидуальной схемы лечения, проводит диагностику, назначает препараты и контролирует состояние пациента на всех этапах терапии. Нарколог подбирает препараты, которые помогают снять симптомы абстиненции и восстановить нормальное функционирование организма. Особое внимание уделяется психоэмоциональному состоянию пациента: врач помогает справиться с депрессией и тревожностью, мотивирует на отказ от алкоголя и предотвращает рецидивы. Психологическая поддержка является неотъемлемой частью лечения, способствуя долгосрочному успеху в борьбе с зависимостью.

Ознакомиться с деталями - капельница от запоя на дому цена воронеж

Jerrytearf 2025-01-06 (mon)

Анонимный вывод из запоя — ключевая часть лечения алкогольной зависимости. Мы предлагаем различные методы помощи как в стационаре, так и амбулаторно, с учётом всех особенностей пациента. Высококвалифицированные специалисты и передовые терапевтические технологии обеспечивают эффективное лечение, при этом мы гарантируем полную конфиденциальность, что повышает вероятность успешного исхода. Лечение возможно без страха перед осуждением.

Детальнее - анонимный вывод из запоя на дому нижний новгород

PabloGOX 2025-01-11 (sta)

Клиника «Второй Шанс» работает круглосуточно, чтобы каждый мог получить необходимую помощь в любое время. Мы предлагаем услуги как на дому, так и в стационаре, обеспечивая полную конфиденциальность и индивидуальный подход. Высокий уровень профессионализма наших специалистов позволяет эффективно справляться с абстинентным синдромом и его последствиями.

Изучить вопрос глубже - вывод из запоя на дому недорого капельница санкт-петербург

JaredMow 2025-01-11 (sta)

Для обеспечения эффективности лечения в специализированной клинике используются современные методы, направленные на восстановление физического состояния и стабилизацию психоэмоционального фона. Дополнительно гарантируется полная анонимность, что особенно важно для людей, ценящих конфиденциальность. Независимо от выбранного формата лечения, пациент получает всестороннюю поддержку, ориентированную на его индивидуальные потребности.

Подробнее можно узнать тут - вывод из запоя с выездом челябинск

Mariomag 2025-01-12 (sun)

Запой характеризуется длительным употреблением алкоголя, что приводит к токсическим повреждениям организма. Процедуры вывода из этого состояния направлены на очищение организма и стабилизацию его функций. Важно помнить, что такие услуги, как выведение из запоя, могут быть предоставлены как в стационарных условиях, так и на дому, в зависимости от потребностей пациента. При этом конфиденциальность лечения является ключевым фактором для многих пациентов, опасающихся осуждения со стороны окружающих.

Получить дополнительную информацию - vyvod iz zapoya cena narkologiya krasnodar

Johnnysip 2025-01-16 (thu)

В клинике «Рассвет» в Твери мы предлагаем круглосуточную помощь при алкогольных запоях, обеспечивая быстрый вывод токсинов из организма с помощью капельниц и других эффективных методик.

Получить дополнительные сведения - narkologicheskij centr tver

Jeroldcib 2025-01-16 (thu)

Алкогольная зависимость представляет собой актуальную медицинскую проблему, требующую тщательного подхода. Запой характеризуется длительным, непрерывным употреблением спиртных напитков, что ведёт к физической и психической зависимости. На фоне запойного состояния могут возникнуть тяжёлые нарушения функций органов, увеличивается риск развития таких состояний, как алкогольный делирий. Вывод из запоя становится ключевым этапом в лечении зависимостей, который может осуществляться как в стационарных условиях, так и на дому, в зависимости от состояния пациента. В клинике «Перекресток Надежды» в Челябинске мы предлагаем круглосуточную помощь, чтобы обеспечить максимально эффективное и безопасное лечение при любом варианте вывода из запоя.

Углубиться в тему - вывод из запоя на дому в челябинске

memek basah 2025-01-17 (fri)

I like the valuable information you provide in your articles.

I’ll bookmark your weblog and check again here frequently. I’m quite certain I’ll learn lots of new stuff

right here! Good luck for the next!

RobertAcera 2025-01-18 (sta)

Запой — это опасное состояние, которое развивается у людей с алкогольной зависимостью и характеризуется длительным непрерывным потреблением алкоголя. Это состояние приводит к серьезным нарушениям в организме, как физическим, так и психоэмоциональным. Длительный запой может вызвать множество осложнений, таких как поражение внутренних органов, нервной системы, а также проблемы в социальной и семейной жизни. Однако современная медицина предоставляет эффективные методы вывода из запоя, и одним из наиболее удобных и востребованных является вывод из запоя на дому.

Изучить вопрос глубже - вывод из запоя круглосуточно наркология санкт-петербург

lms.jolt.io 2025-01-23 (thu)

All you have to do is fill up the traeger ironwood

pellet grill review (lms.jolt.io) hopper and adhere to the directions on the electronic controller.

Social - Fep 2025-01-25 (sta)

Reasons Why Online Casinos Remain a Worldwide Trend Online casinos have revolutionized the casino gaming scene offering a level of ease and range that brick-and-mortar establishments struggle to rival. Recently a growing community worldwide have adopted the excitement of virtual casinos due to its accessibility appealing qualities and widening collections of titles. One of the most compelling reasons of internet-based platforms is the sheer array of gaming experiences available. Whether you like playing on classic one-armed bandits playing through narrative-rich visual slot games or mastering skills in classic casino games like Texas Hold’em internet-based gambling sites offer endless entertainment avenues. A large number of platforms even include live gaming streams letting you to engage with real dealers and gaming peers all while immersing yourself in the immersive vibes of a land-based casino in your own space. If you’re a beginner with the world of internet-based gaming or seek to learn about trusted platforms why not join our growing online hub? It’s a platform where players post stories helping you to maximize your gaming journey. Join the experience and see it here now: https://www.linkedin.com/in/my-stake-a096b427a/ Apart from the game range online casinos are known for ease of access.

Ashlee 2025-01-30 (thu)

Extremely, we liked cigarette bbq smokers - Ashlee, that had several flexible

dampers.

Casinò live Winnita 2025-02-14 (fri)

Cosa aspetti? Vivi a vivere il brivido delle vincite su Winnita Casinò online!

La esperienza, protetta e legittima, ti offre l’opportunità

di mettere alla prova la tua fortuna in un ambiente creato appositamente per chi cerca adrenalina.

Ogni gioco è un passo verso una sua realizzazione, e

tu sei il protagonista della tua avventura. Non perdere l’occasione

di fare il tuo primo spin di rulli!

Casinò live Winnita

Jogue Demo 2025-03-07 (fri)

Jogue FortuneRabbit agora e descubra o que este cassino tem de imperdível. Com ganhos de até 5000 vezes, a sorte pode mudar em segundos. Não há necessidade de adquirir nada, basta acessar o plataforma e começar a se divertir. Não perca a chance de ganhar prêmios incríveis com FortuneRabbit.

Katiesek 2025-03-15 (sta)

I wholeheartedly agree this really counts. ?? https://www.shreedesignteam.com/thmyl-brnmj-1xbet-lkml-llb-lkzynw-br-lntrnt-fy-msr/https://clinicadentalcarlosmartin.es/thmyl-brnmj-1xbet-lb-lkzynw-l-lntrnt-fy-msr/uncategorized/http://sungbotech.com/htfl-bmmtzt-lrbh-fy-1xbet-stmt-blb-lkzynw-l-lntrnt/https://www.dreamincubator.com/in/stmt-blb-lkzynw-l-lntrnt-m-1xbet-fy-msr/https://hs460cnaunjn.wordpress.com/2025/03/05/htfl-blb-l-1xbet-fdl-mns-llkzynw-br-lntrnt-fy-lswdy/https://sangriafrancesa.wordpress.com/2025/03/05/fdl-mwq-lb-lkzynw-br-lntrnt-1xbet/http://test.xxcross.com/2025/03/04/thmyl-brnmj-1xbet-lb-lkzynw-lwnlyn-fy-msr/

Brilliant Clean kommentieren 2025-03-15 (sta)

Ich mag es, ihre Webseite zu durchstöbern. Herzlichen Dank!

Brilliant Clean kommentieren

EOTechjmc 2025-04-22 (tue)

handwritten books were made

1xbet 2025-05-01 (thu)

The knowledge on this topic really is apparent.

Learned several new insights from this article. 1xbet

купить держатель шуруповерта 2025-11-17 (mon)

Спасибо за полезные советы по интерьеру! Хочу поделиться находкой: купить держатель шуруповерта — удобный магазин для тех, кто хочет навести уют и организовать вещи. Есть фильтры, фото и описания, вот ссылка: https://forum.emteria.com/home/leaving?target=https://www.cheekymagpie.org/profile/hoahnoahm21495/profile.

Boonforal 2025-11-21 (fri)

บทความนี้ให้ข้อมูลมีประโยชน์มากเกี่ยวกับการแสดงความเคารพผู้ล่วงลับ

การเลือกพวงหรีดดอกไม้ถือเป็นเรื่องสำคัญ

เราเคยใช้บริการร้านพวงหรีดจัดส่งถึงวัด ซึ่งทั้งสะดวกและตรงเวลา

แนะนำสำหรับใครที่กำลังมองหาร้านพวงหรีดคุณภาพครับ ������

Also visit my web-site :: Boonforal

Grantplomb 2025-12-17 (wed)

Привет всем. Использую этот софт по накрутке пф в яндексе

api integration 2025-12-17 (wed)

Useful content for anyone learning N8n chatbot tutorial and workflow automation tool for chatbot

platform and messaging apps

N8n Chatbot template 2025-12-18 (thu)

This guide on n8n integration is incredibly helpful for people exploring chatbot automation.

I really liked how it explained no-code automation step by

step — perfect for beginners and developers alike.

It’s impressive how n8n can connect to facebook messenger bot without heavy coding knowledge.

Definitely worth trying if you’re building your first automation system using n8n!

สงครามข่าวสาร 2025-12-20 (sta)

เนื้อหานี้สรุป ข่าววันนี้ ได้กระชับ เหมาะกับคนที่ติดตามข่าวชายแดน โดยเฉพาะประเด็นชายแดนกัมพูชา ความมั่นคงชายแดน และข่าวด่วนที่อัปเดตต่อเนื่อง

Grantplomb 2025-12-23 (tue)

Привет .. Использую этот сервис по поведенческих в поисковых системах

Grantplomb 2026-01-09 (fri)

Привет народ. Использую этот решение по пф в яндекс